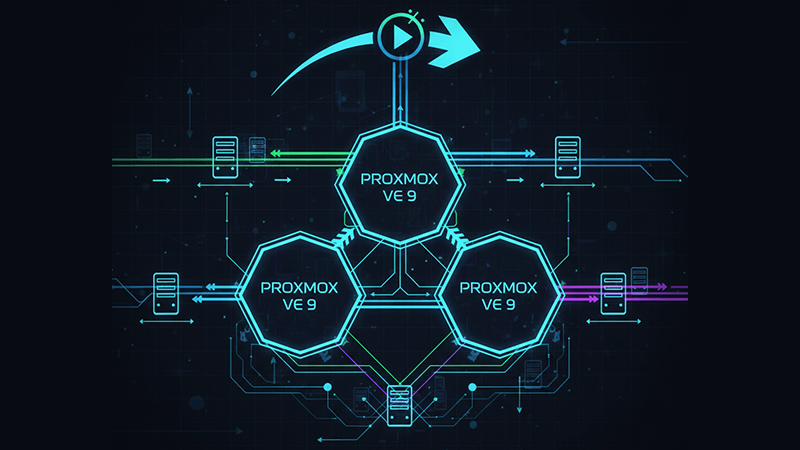

Proxmox VE 9 的实时迁移功能允许虚拟机在保持在线状态下在集群节点间迁移。在生产环境中,该过程必须安全转移活动内存、进行中的磁盘写入及执行状态,同时确保服务不中断。对于运行 Proxmox VE 9 集群的组织而言,理解实时迁移的内部运作机制对于在维护、升级及容量重新平衡期间维持系统正常运行至关重要。

实时迁移在Proxmox VE 9虚拟化中的重要性

在Proxmox VE 9集群内,实时迁移支持滚动更新、硬件维护及主动工作负载重分配。通过加强QEMU、KVM、集群服务与存储处理之间的协同,Proxmox VE 9显著提升迁移可靠性,在合理配置下可支持共享存储与本地存储方案,并确保行为可预测性。

执行实时迁移前的核心要求

启动任何Proxmox VE实时迁移流程前,环境必须满足以下基础条件:

- 所有节点必须属于同一Proxmox VE 9集群

- 存储定义需在集群范围内存在且存储ID完全一致

- 各节点CPU架构必须兼容

- 节点间网络连接需稳定且低延迟

- 目标节点需具备充足的可用内存和存储空间

预先满足这些条件可避免最终迁移阶段出现卡顿和失败。

存储架构与迁移行为

存储设计直接影响 Proxmox 集群迁移性能。

使用 NFS、Ceph RBD、CephFS 或 iSCSI 等共享存储时,所有节点均可访问虚拟机磁盘。仅传输内存和 CPU 状态,使迁移快速且一致。

采用本地存储(如ZFS或LVM精简配置)时,Proxmox执行实时磁盘镜像。虚拟机运行期间同步磁盘块,持续追踪变更直至收敛。迁移时长取决于磁盘延迟、吞吐量及写入强度。

弃用策略、SSD仿真、QCOW2分层及快照等功能可能增加CPU和I/O负载,影响迁移速度与稳定性。

分步解析:Proxmox VE 9 实时迁移工作原理

步骤 1:迁移初始化

迁移可通过手动、高可用性机制或自动化触发。Proxmox 将验证配置、存储映射及节点兼容性。

步骤 2:目标节点准备

目标节点创建暂停状态的虚拟机实例,预置虚拟硬件与网络接口。

步骤 3:磁盘处理

共享存储仅需最小磁盘操作

本地存储触发实时磁盘镜像同步并追踪变更

步骤4:内存同步

内存页进行迭代传输。修改过的页面反复重传直至剩余差异微小

步骤5:最终切换

虚拟机短暂暂停,剩余内存与CPU状态完成传输,虚拟机在目标节点恢复运行

步骤6:清理

释放源端资源,迁移完成

该过程对客户机操作系统透明,确保应用程序和数据库保持在线状态。

迁移临近完成时偶发卡顿的原因

当迁移在最终阶段出现卡顿时,常见原因包括:

- 磁盘延迟导致最终同步受阻

- 网络数据包丢失或MTU不一致

- 并发迁移任务过多

- 内核特有的隧道行为

专用迁移网络、限制并发数以及统一的内核和MTU设置可降低这些风险。

实时迁移与高可用性故障转移的区别

实时迁移可保留虚拟机内存和CPU状态,而高可用性故障转移则无法实现。节点故障时,虚拟机将在其他节点重启,期间不可避免出现停机。实时迁移支持可控迁移,高可用性则侧重故障后的恢复。